CycleGAN(1/4)発明の概要

はぐれ弁理士 PA Tora-O です。今回のテーマとして、敵対的生成ネットワーク(GAN)ベースの画像処理の一手法である CycleGAN を題材に取り上げます。

背景

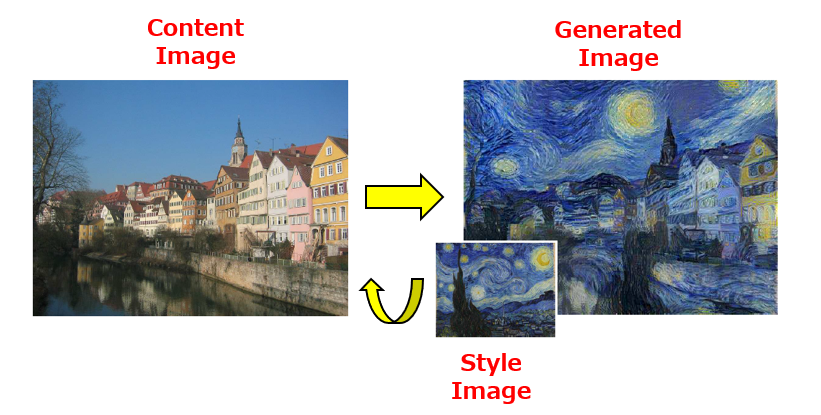

生成モデルのバリエーション(Variants)の1つとして、画像の作風を変える画風変換(Image Style Transfer)が挙げられます。例えば、Leon A. Gatys 氏らによる “Neural Style Transfer”(以下、NST)が知られています。

出展:Image Style Transfer Using Convolutional Neural Networks

このNSTは、[1]コンテンツ画像との誤差(Content Loss)、[2]スタイル画像との誤差(Style Loss)を含む評価関数を求め、当該関数が最小になるように画像を逐次的に更新する手法です。これらの損失項は、学習済みのCNN(例えば、VGG19)が段階的に生成する特徴マップ(Feature Maps)を用いて計算されます。

具体的には、[1]画像の生成に先立ち、コンテンツ画像およびスタイル画像をVGG19にそれぞれ投入し、得られた特徴マップから「コンテンツ」及び「スタイル」の目標値を定めた上で、[2]画像を更新する度に最新の画像をVGG19に投入し、得られた特徴マップから「コンテンツ」及び「スタイル」の目標値との乖離を示す評価関数を算出します。

問題の所在

要するに、NSTでは、単一のニューラルネットを用いて画像特徴量を生成し、画素単位で逐次的に画素値を更新させながら最適解としての画像を完成させます。このように、NSTは、画像を生成する際に逆畳み込みニューラルネット(つまり、DNN)を使っていないので、従来の統計的手法と同様に、画像を完成させるまでの演算時間が掛かるという問題がありました。

解決手段

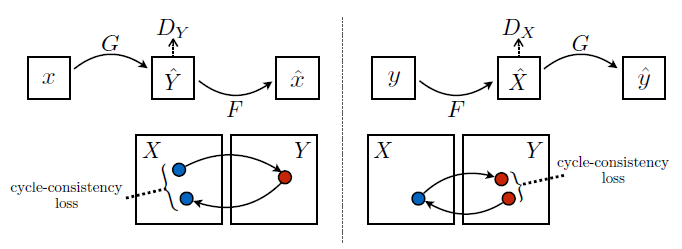

そこで、GANをベースにした画風変換モデル “CycleGAN” が Jun-Yan Zhu 氏らによって提案されました。このネットワーク構造の概要(図2)および画像生成結果(図3)は以下の通りです。

出展:Unpaired Image-to-Image Translation using Cycle-Consistent Adversarial Networks

この手法の特徴は、Pix2Pix のような一方向的な変換(unidirectional transfer)ではなく、双方向的な変換(bidirectional transfer)が行えるという点です。あと、図2の内容ではネットワーク構造がイメージしにくいかもしれないので、もう少し補足が必要そうです。

以上、今回(第1回)は、CycleGAN の概要について説明しました。次回(第2回)は、CycleGAN の実施例について説明します。

↓ブログランキングに参加しています。よろしければ1クリックお願いします。

ディスカッション

コメント一覧

まだ、コメントがありません