CycleGAN(4/4)総括

はぐれ弁理士 PA Tora-O です。前回(第3回)では、CycleGAN における学習メカニズムについて概説しました。改めて復習されたい方は、こちらのリンクから確認をお願いします。今回(第4回)は、クレームを含む発明ストーリーを作成し、これまで3回分の検討を総括します。

発明ストーリー

【従来技術】

生成モデルのバリエーションの1つとして、画像の作風を変える画風変換が挙げられる。画風変換の手法の一例として、Gatys 氏らによる Neural Style Transfer (NST) や、Isola 氏らによる Pix2Pix が知られている。

【問題点と課題】

問題点は、NSTでは、画像生成時において、変換処理の対象である第1画像と、画風の見本を示す第2画像をペアで提示する必要があること。Pix2Pix では、生成器の学習時において、変換処理の対象である第1画像と、変換後の見本を示す第2画像をペアで提示する必要があること。

課題は、作風または変換後の見本を個別具体的に提示せずに、作風に関する変換または学習を行うこと。

【クレーム骨子】(CycleGAN)

第1学習データの母集団である第1学習データ群および第2学習データの母集団である第2学習データ群を用いて、敵対的生成ネットワーク(GAN)システムに対して学習を行う方法であって、

GANシステムは、

第2学習データを入力し、第1学習データと同一のデータ形式を有するデータを出力する第1生成器と、

第1学習データを入力し、第2学習データと同一のデータ形式を有するデータを出力する第2生成器と、

を含んで構成され、

学習に用いられる目的関数は、第2生成器と第1生成器による一連の処理の前後にわたる第1学習データの変化量、および、第1生成器と第2生成器による一連の処理の前後にわたる第2学習データの変化量を示す損失項を含むことを特徴とする学習方法。(315文字)

【作用効果】

第1および第2生成器を含んで構成される敵対的ネットワークシステムに対して、第1および第2学習データの変化量を示す損失項を含む目的関数を用いた学習を行うことで、第1生成器は、入力されたデータの中から第2学習データに共通する第2特徴を抽出するとともに、抽出した第2特徴を第1学習データに共通する第1特徴に置換する能力を獲得するようになる。同様に、第2生成器は、入力されたデータの中から第1学習データに共通する第1特徴を抽出するとともに、抽出した第1特徴を第2学習データに共通する第2特徴に置換する能力を獲得するようになる。これにより、作風または変換後の見本を個別具体的に提示せずに、作風に関する変換や学習を行うことができる。

作者コメント

「問題点と課題」の流れは、本論文の記載内容を踏まえて作成しました。従来の手法では作風を単に再現するのに対して、本手法では作風の抽出および置換を行う点が異なっています。この相違点をもう少し強調してもよいかもしれません。

また、「クレーム骨子」に関して、文字数を極力減らす方針で作成しました。具体的には、「GANシステム」という文言を用いることで、GAN前提の構成(弁別器や敵対的損失)を省略しています。当然、特許法36条違反の可能性もあり得ますので、明細書中には具体的に記載すべきでしょう。

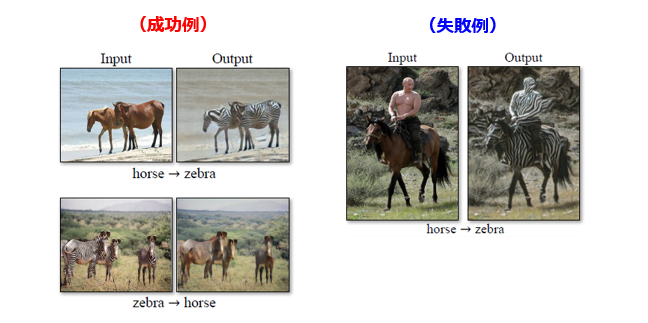

最後に、本論文中に挙げられているリンゴ/オレンジ以外の別例について紹介します。

本図は、馬(horse)とシマウマ(zebra)の変換結果の一例を示しています。ここでは、成功例・失敗例の両方とも、前景領域(=馬体)の色は概ね正しく変換されたように思えます。ただし、前景領域を正確に認識・区画できている訳ではなく、背景領域(=馬体以外の領域)の一部の色も変換されてしまうようです。特に、右側の失敗例は、学習データベースの中に人間が馬に騎乗した画像が1枚も無いために起こった、と論文中で分析されています。やはり、学習データの様々なバリエーションを収集することで、処理結果の妥当性が確率論的に高まる、と言うことでしょう。

以上をもちまして、CycleGAN の事例検討を終了します。次回から、また別のテーマに移ります。

↓ブログランキングに参加しています。よろしければ1クリックお願いします。

ディスカッション

コメント一覧

まだ、コメントがありません